OpenAI的取名藝術鑑賞

Categories:

這裡https://platform.openai.com/docs/models/記錄了 OpenAI 的所有模型。

太遠了的不說,從 GPT-4 系列及同世代模型聊起,這是我彙總的表格:

| 名稱 | 描述 | 模型卡片連結 |

|---|---|---|

ChatGPT-4o | GPT-4o model used in ChatGPT | https://platform.openai.com/docs/models/chatgpt-4o-latest |

GPT-4 | An older high-intelligence GPT model | https://platform.openai.com/docs/models/gpt-4 |

GPT-4 Turbo | An older high-intelligence GPT model | https://platform.openai.com/docs/models/gpt-4-turbo |

GPT-4 Turbo Preview | Deprecated An older fast GPT model | https://platform.openai.com/docs/models/gpt-4-turbo-preview |

GPT-4.1 | Smartest non-reasoning model | https://platform.openai.com/docs/models/gpt-4.1 |

GPT-4.1 mini | Smaller, faster version of GPT-4.1 | https://platform.openai.com/docs/models/gpt-4.1-mini |

GPT-4.1 nano | Fastest, most cost-efficient version of GPT-4.1 | https://platform.openai.com/docs/models/gpt-4.1-nano |

GPT-4.5 Preview | Deprecated large model. | https://platform.openai.com/docs/models/gpt-4.5-preview |

GPT-4o | Fast, intelligent, flexible GPT model | https://platform.openai.com/docs/models/gpt-4o |

GPT-4o Audio | GPT-4o models capable of audio inputs and outputs | https://platform.openai.com/docs/models/gpt-4o-audio-preview |

GPT-4o mini | Fast, affordable small model for focused tasks | https://platform.openai.com/docs/models/gpt-4o-mini |

GPT-4o mini Audio | Smaller model capable of audio inputs and outputs | https://platform.openai.com/docs/models/gpt-4o-mini-audio-preview |

GPT-4o mini Realtime | Smaller realtime model for text and audio inputs and outputs | https://platform.openai.com/docs/models/gpt-4o-mini-realtime-preview |

GPT-4o mini Search Preview | Fast, affordable small model for web search | https://platform.openai.com/docs/models/gpt-4o-mini-search-preview |

GPT-4o mini Transcribe | Speech-to-text model powered by GPT-4o mini | https://platform.openai.com/docs/models/gpt-4o-mini-transcribe |

GPT-4o mini TTS | Text-to-speech model powered by GPT-4o mini | https://platform.openai.com/docs/models/gpt-4o-mini-tts |

GPT-4o Realtime | Model capable of realtime text and audio inputs and outputs | https://platform.openai.com/docs/models/gpt-4o-realtime-preview |

GPT-4o Search Preview | GPT model for web search in Chat Completions | https://platform.openai.com/docs/models/gpt-4o-search-preview |

GPT-4o Transcribe | Speech-to-text model powered by GPT-4o | https://platform.openai.com/docs/models/gpt-4o-transcribe |

GPT-4o Transcribe Diarize | Transcription model that identifies who’s speaking when | https://platform.openai.com/docs/models/gpt-4o-transcribe-diarize |

o1 | Previous full o-series reasoning model | https://platform.openai.com/docs/models/o1 |

o1-mini | A small model alternative to o1 | https://platform.openai.com/docs/models/o1-mini |

o1-pro | Version of o1 with more compute for better responses | https://platform.openai.com/docs/models/o1-pro |

o3 | Reasoning model for complex tasks, succeeded by GPT-5 | https://platform.openai.com/docs/models/o3 |

o3-pro | Version of o3 with more compute for better responses | https://platform.openai.com/docs/models/o3-pro |

o3-mini | A small model alternative to o3 | https://platform.openai.com/docs/models/o3-mini |

o4-mini | Fast, cost-efficient reasoning model, succeeded by GPT-5 mini | https://platform.openai.com/docs/models/o4-mini |

針對音頻(Audio)、實時(Realtime)、搜尋(Search)、音頻轉文字(Transcribe)、文字轉語音(TTS) 等場景,全都有相應模型。

對同一場景,如音頻Audio場景,提供了 GPT-4o Audio 和 GPT-4o mini Audio 兩個模型,用戶需要透過嘗試決定能否接受效果。

音頻轉文字Transcribe場景,提供了 GPT-4o Transcribe、GPT-4o mini Transcribe、GPT-4o Transcribe Diarize 三個模型。ChatGPT-4o 是 GPT-4o 的特別版,用於 ChatGPT 中,其他場景不能用。GPT-4.1比GPT-4更好,是符合直覺的,但GPT-4o(4 歐)和GPT-4.1或GPT-4卻不好比較。時間線上,先出現的是GPT-4,然後是GPT-4o,再然後是GPT-4.1,當然,仍然無法判斷GPT-4o和GPT-4.1誰更好。

這裡插入下對「好」的定義,我個人將數學和推理結果正確率高作為「好」的定義,完全不將「速度」納入「好」的定義。但此前 OpenAI 可能認為速度和智慧同樣重要,因此出現奇怪的模型對比。進入 GPT-5 時代後,慶幸 OpenAI 開始放棄速度,追求智慧,至此模型間的對比才沒有歧義。一個快速的錯誤回答是浪費時間,沒有意義。

在GPT-4時代,我摸索了小半年才發現o3是當時最好的模型,確認後我就只用它來解 bug 了。你可以看到它的描述"Reasoning model for complex tasks, succeeded by GPT-5"。OpenAI 直接選擇o3路線,推出下一代模型GPT-5。

我相信會有很多人和我一樣在這一堆模型裡摸索,最後 OpenAI 能從後台發現,大家不約而同停留在o3上。

還有一個孤立的模型o4-mini,沒有o4模型,只有o4-mini。o3的繼任者是GPT-5,o3-mini沒有繼任者,o4-mini的繼任者是GPT-5 mini。

進入 GPT-5 時代對 OpenAI 來說是一個分水嶺,從此 OpenAI 開始放棄速度,追求智慧。放棄那麼多分支,對一家大企業來說是一個艱難的決定,但我相信這是正確的決定。

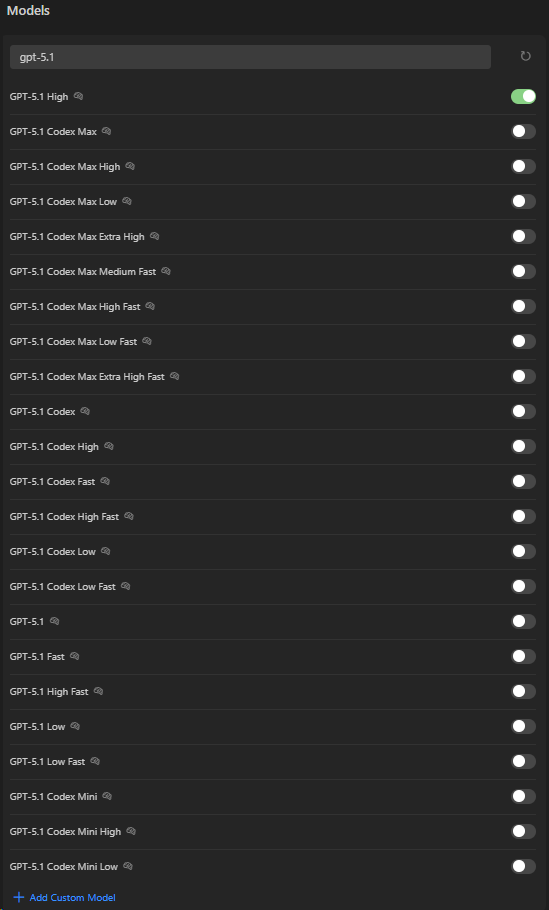

這是 Cursor 中的 GPT-5 系列模型選擇介面:

GPT-5 系列模型命名更規律,更符合直覺。

新的命名規則:基座版本 + 特化 + 規模 + 推理強度 + 計算資源

如:GPT-5.1-Codex-Max-High-Fast

儘管排列組合後仍然是一大堆,但至少不會像 GPT-4 系列模型那樣讓人一頭霧水。